Ecouter la version audio :

Lire la version texte:

Résumé IA:

L’article met en lumière la fracture géopolitique et philosophique qui oppose les États-Unis et l’Union européenne dans leur manière d’aborder l’intelligence artificielle. D’un côté, les États-Unis misent sur une dérégulation forte, favorisant l’innovation rapide, l’allègement des contraintes légales et une approche flexible des risques pour maintenir leur avantage compétitif mondial. De l’autre côté, l’Europe privilégie une régulation stricte axée sur la protection des droits fondamentaux et la gestion des risques, incarnée notamment par l’AI Act et d’autres cadres normatifs visant à garantir transparence, sécurité et éthique dans le développement et l’utilisation des IA. Cette dualité reflète deux visions opposées de l’IA : moteur de croissance économique contre outil à encadrer pour préserver des valeurs sociales et juridiques.

L’IA, entre dérégulation américaine et précaution européenne : une bataille technologique, politique et philosophique

L’intelligence artificielle est souvent présentée comme une révolution technologique. Mais lorsqu’on prend un peu de recul, on comprend rapidement que le véritable débat dépasse largement la seule question des performances techniques. Derrière les modèles, les benchmarks et les levées de fonds se dessinent des visions du monde radicalement différentes, des choix politiques assumés et, plus profondément encore, une interrogation sur ce que ces outils font à notre manière de penser et de travailler.

Deux visions fondatrices de l’intelligence artificielle

Les grands acteurs de l’IA ne développent pas cette technologie au hasard. Chez Google, l’approche est clairement ancrée dans la mission historique de l’entreprise : organiser l’information mondiale et la rendre universellement accessible. Cette vision se décline en trois principes : une innovation audacieuse, un développement responsable et un progrès collaboratif.

C’est précisément la tension entre innovation et responsabilité qui cristallise les débats. Innover, c’est prendre des risques, repousser les limites, avancer vite. Être responsable, c’est intégrer des garde-fous : supervision humaine, audits de biais, protection des données personnelles. L’équilibre est fragile, presque acrobatique. Chaque avancée spectaculaire doit être accompagnée d’un dispositif éthique interne, souvent conçu pour devancer l’intervention des régulateurs.

Cette tension interne aux entreprises se retrouve à une échelle bien plus large.

États-Unis contre Europe : le choc des philosophies réglementaires

Côté américain, la stratégie est résumée sans détour par un slogan : “Winning the AI Race”. L’objectif est clair : gagner la course mondiale à l’IA. Le plan repose sur quatre piliers : exporter massivement les technologies américaines, accélérer la construction d’infrastructures comme les data centers, lever les freins réglementaires jugés excessifs et défendre une conception très large de la liberté d’expression appliquée aux modèles d’IA.

Pour les partisans de cette approche, toute forme de modération freine l’innovation. Pour ses détracteurs, elle ouvre la voie à une diffusion incontrôlée de désinformation, de discours haineux et de manipulations à grande échelle.

L’Europe adopte une posture diamétralement opposée avec l’AI Act. Ici, le cœur du raisonnement n’est pas la liberté d’expression, mais la gestion du risque. Les usages sont classés en plusieurs niveaux : risques inacceptables (interdits), risques élevés (fortement encadrés), risques limités (obligations de transparence) et risques minimaux (librement utilisés). Cette approche reflète une vision de l’IA comme enjeu de société, nécessitant la protection des droits fondamentaux avant toute chose.

Une course technologique à trois acteurs majeurs

Cette bataille réglementaire est indissociable d’une compétition technologique féroce entre les grands modèles de langage. Les noms qui dominent le paysage sont aujourd’hui OpenAI, Google et l’outsider européen Mistral AI.

Les grands modèles de langage, ou LLM, reposent sur un principe simple : prédire le mot suivant le plus probable. Répétée des milliards de fois, cette opération permet au modèle d’assimiler grammaire, contexte, style et connaissances générales.

OpenAI a été le déclencheur de l’IA générative grand public. Son modèle phare a séduit par sa créativité et sa fluidité, au point de devenir progressivement une véritable plateforme, intégrant applications, abonnements et bientôt des fonctionnalités de commerce.

Google, après un départ jugé plus hésitant, est revenu en force avec une stratégie d’intégration totale. Son modèle Gemini a été conçu dès l’origine comme multimodal et profondément imbriqué dans l’écosystème Google : moteur de recherche, messagerie, bureautique. Sur certains benchmarks récents, les performances techniques ont clairement rebattu les cartes.

Mais la surprise vient de Mistral AI. En misant sur des modèles plus compacts, efficaces et largement ouverts, la startup française parvient à rivaliser avec les géants américains sur des tests complexes. Au-delà de la performance, c’est un enjeu de souveraineté numérique européenne qui se joue.

L’IA sur le terrain : l’exemple concret de l’assurance

Loin des discours anxiogènes sur le remplacement de l’humain, certaines entreprises montrent une autre voie. Le cas du groupe d’assurance Covéa est particulièrement éclairant. Leur approche repose sur une idée simple : l’IA n’est pas là pour décider à la place de l’humain, mais pour l’augmenter.

Un outil interne analyse des dossiers de sinistres complexes et en produit une synthèse intelligente en quelques secondes. Résultat : le temps de compréhension est divisé par deux, sans retirer à l’expert la responsabilité finale. L’IA prend en charge la lecture et la compilation, l’humain se concentre sur l’analyse, la décision et la relation avec l’assuré.

Une étude citée du cabinet KPMG montre d’ailleurs que près de trois quarts des dirigeants du secteur de l’assurance considèrent l’IA comme un investissement stratégique majeur. Ici, la technologie devient un levier de qualité et d’empathie, pas un substitut.

Une question philosophique : que fait l’IA à notre intelligence ?

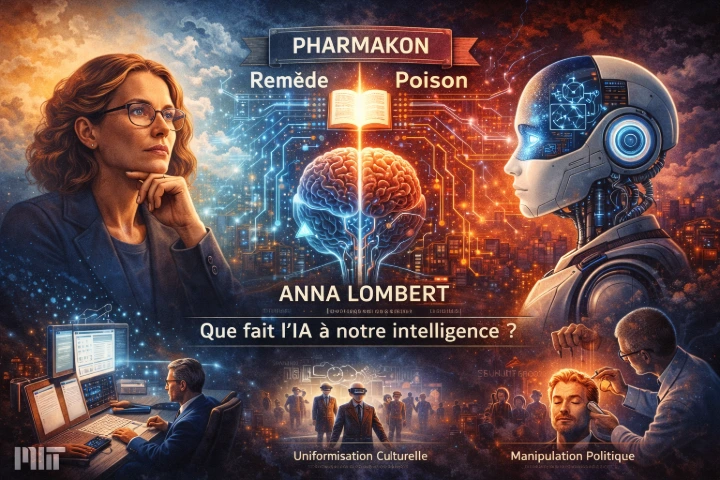

Le débat prend une dimension plus profonde avec les réflexions de la philosophe Anna Lombert. Son point de départ est déroutant : notre intelligence a toujours été artificielle. Depuis l’écriture jusqu’aux outils modernes, la pensée humaine s’est constamment appuyée sur des extensions technologiques.

En s’inspirant du concept grec de pharmakon, à la fois remède et poison, elle identifie trois risques majeurs liés à l’IA : la dépendance cognitive, l’uniformisation culturelle et la manipulation politique. Une étude du MIT montre par exemple qu’une majorité d’utilisateurs sont incapables de se souvenir d’un texte qu’ils viennent pourtant de générer avec une IA. L’effort intellectuel externalisé ne s’ancre plus dans la mémoire.

Face à ces risques, la solution n’est pas le rejet pur et simple. D’autres penseurs défendent l’idée que l’IA rend, paradoxalement, nos compétences les plus humaines encore plus précieuses : esprit critique, créativité, intuition, empathie. L’enjeu n’est plus de faire penser la machine comme un humain, mais de s’en servir pour mieux penser ensemble.

Conclusion : une co-évolution à maîtriser

Au final, ce panorama révèle une série de tensions permanentes : entre innovation et responsabilité, entre dérégulation et précaution, entre substitution et augmentation de l’humain. La véritable course ne se joue peut-être pas uniquement entre Google, OpenAI et Mistral. Elle se joue aussi dans la manière dont nous choisissons d’intégrer ces outils à nos pratiques quotidiennes.

La question essentielle n’est donc pas seulement : que deviendra l’intelligence artificielle ? Mais plutôt : alors que nous lui déléguons une part croissante de nos processus cognitifs, que choisissons-nous, nous, de devenir ?